GARAGE GPT 👽

Projet pour héberger un Chat-GPT local s'appuyant sur les projets Ollama et OpenWebUI

PREREQUIS 📎

- Docker 🐳

MODELS 🗿

- compatibles: Ollama modèles librairie

CONFIGURATION 🔧

BASE

Nous pouvons laisser OpenWebUI gérer les comptes utilisateur, le premier utilisateur étant d'office administrateur.

- Modifier la variable à "true" si on utilise pas OICD:

- "ENABLE_LOGIN_FORM=false"

OIDC 🔑

Renseigner les variables d'environnement dans le docker-compose.yml:

- "ENABLE_OPENAI_API=true"

- "OPENAI_API_KEY="

- "OAUTH_CLIENT_ID=ai"

- "OAUTH_CLIENT_SECRET=redacted"

- "OPENID_PROVIDER_URL=https://keycloak/auth/realms/realm/.well-known/openid-configuration"

- "OAUTH_PROVIDER_NAME=keycloak"

- "OAUTH_SCOPES=openid profile email"

GPU USE

- Installer NVIDIA container toolkit:

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg \

&& curl -s -L https://nvidia.github.io/libnvidia-container/stable/deb/nvidia-container-toolkit.list | \

sed 's#deb https://#deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://#g' | \

sudo tee /etc/apt/sources.list.d/nvidia-container-toolkit.list

sed -i -e '/experimental/ s/^#//g' /etc/apt/sources.list.d/nvidia-container-toolkit.list

sudo apt-get update

sudo apt-get install -y nvidia-container-toolkit

- Décommenter la section suivante:

deploy:

resources:

reservations:

devices:

- driver: nvidia

count: 1

capabilities: [gpu]

UTILISATION 🏁

- Démarrer la stack:

docker compose up -d

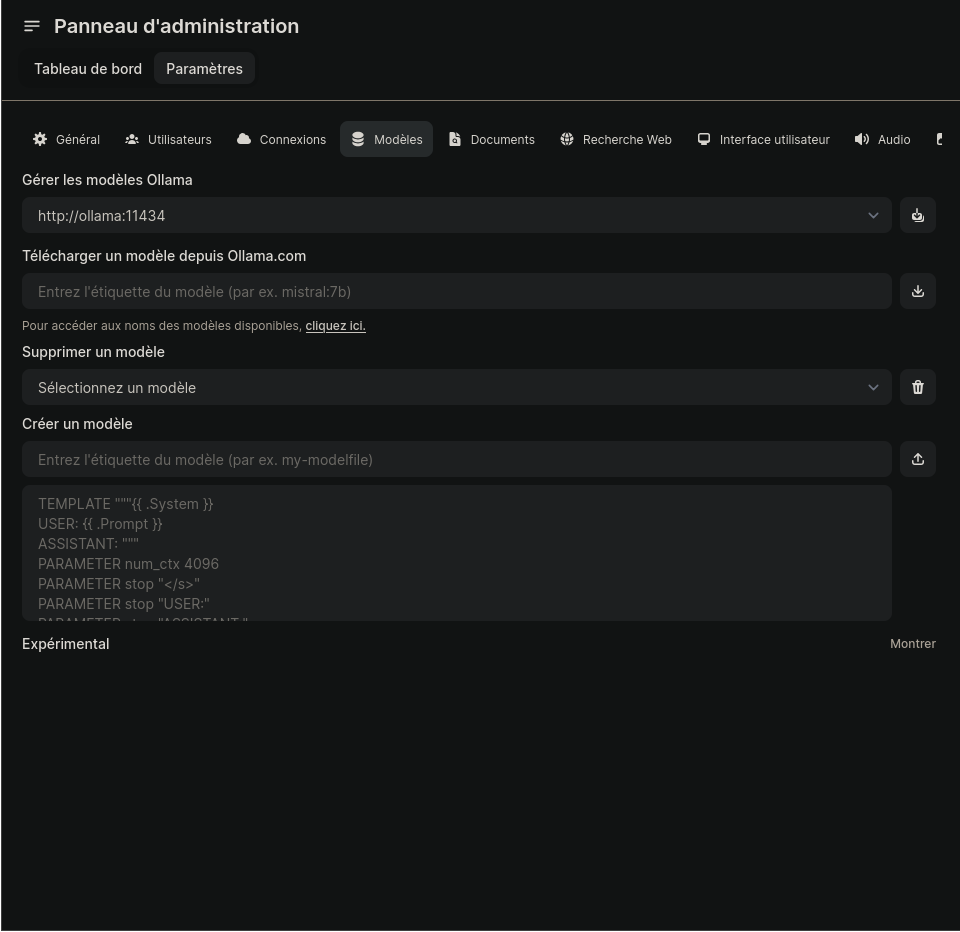

- Ajouter des modèles:

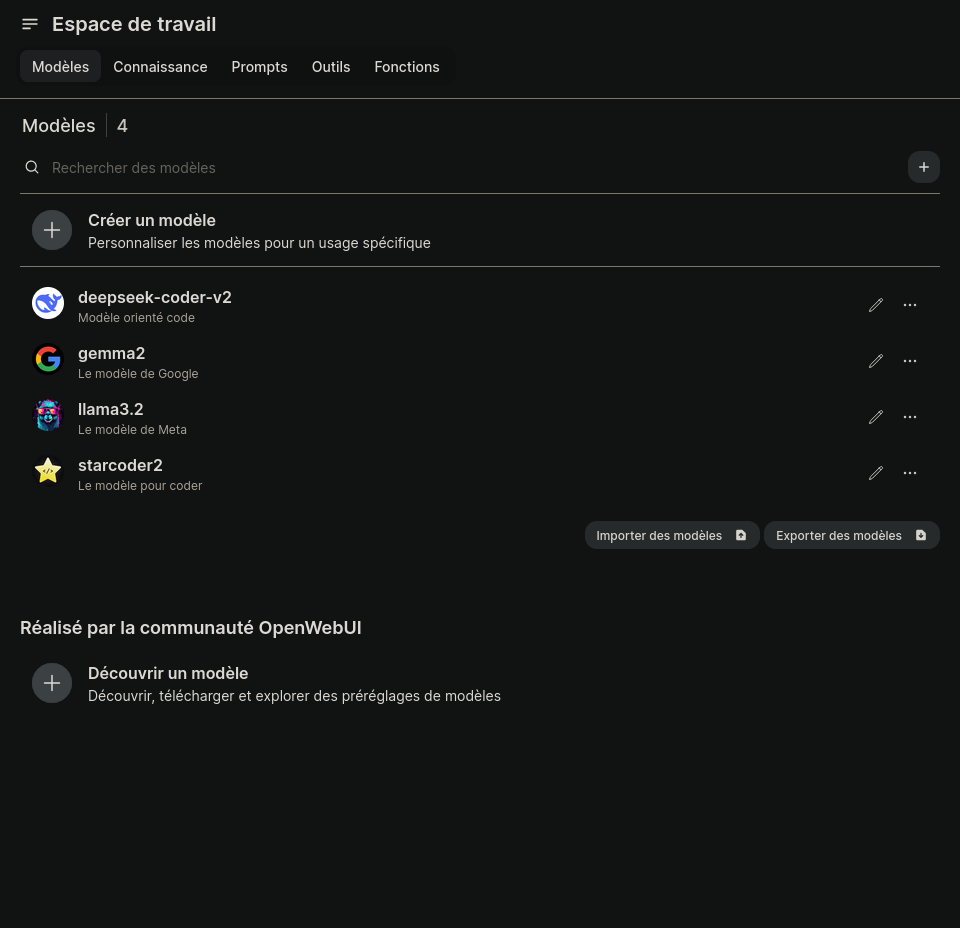

- Choisir les modèles disponible pour les utilisateurs:

DOCUMENTATION 📚

Languages

YAML

100%